这次是人机对话模型ESIM,全称Enhanced Sequential Inference Model,一种增强序列推断模型。

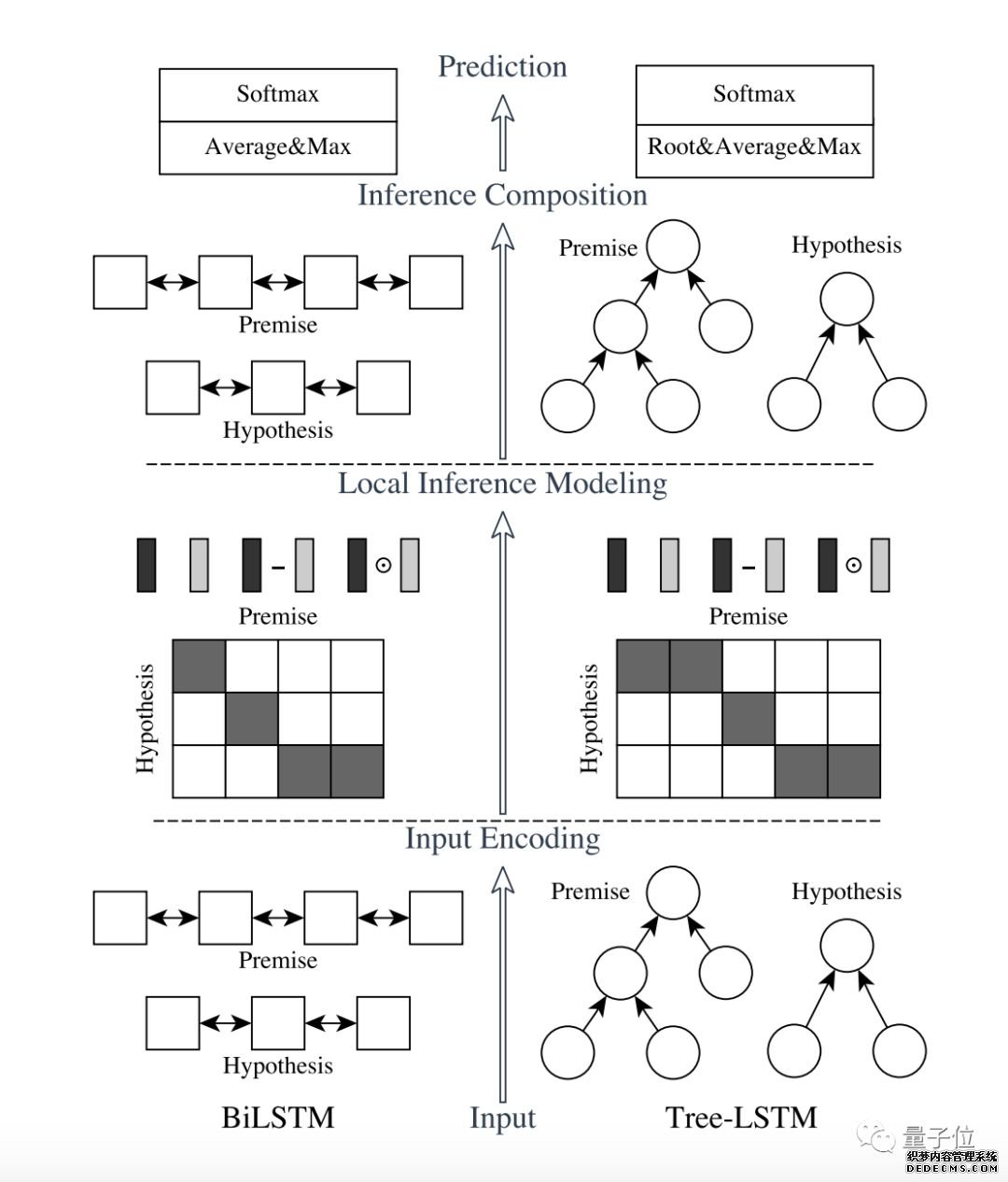

其次,在局部推断建模阶段。使用基于注意力的软对齐,来获得前提和假设之间的局部相关性。

更多细节,请收好论文链接:

这一模型的主要应用场景为智能客服、导航软件、智能音箱等,现在已经被阿里巴巴应用到语音点餐机、地铁语音售票机、汽车交互系统等应用中。

阿里巴巴,AI开源又有新动作。

首先,在输入编码阶段,输入前提(Premise)和假设(Hypothesis)。在这一部分,BiLSTM学习如何表示一个单词及其上下文。

ESIM是什么?

ESIM首次提出是在2017年,论文的名称中就给出了直接的介绍:

从论文给出的模型架构图来看,ESIM模型由三个部分组成(下图左边部分是ESIM模型,右侧部分表示包含语法分析信息的网络):输入编码(Input Encoding)、局部推断建模(Local Inference Modeling)和推断合成(Inference Composition)。

模型发布之后,便引发了极大关注,不仅在DSTC 7上拿下冠军,还成为了许多新发布数据集的评测标准之一,比如纽约大学的MultiNLI数据集、华盛顿大学的SWAG数据集等等。

https://github.com/alibaba/esim-response-selection

陈谦,27岁,90后,博士毕业于中科大。2018年加入阿里巴巴,是2018届的阿里星之一。

Enhanced LSTM for Natural Language Inference,应用到自然语言推断的强化版LSTM。

达摩院90后科学家研发ESIM模型,最初由达摩院语音实验室的陈谦等人研发。

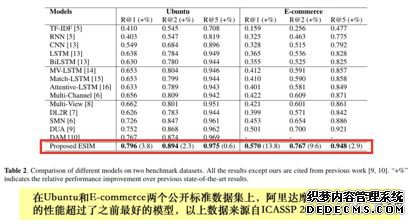

阿里介绍称,自2017年首次提出以来,这一研究已被谷歌、Facebook等在内的研究者在论文中引用200多次,也一度在国际顶级对话系统评测大赛(DSTC7)上获得双料冠军,将人机对话准确率的世界纪录提升至94.1%。

https://arxiv.org/abs/1901.02609

最后,为了确定前提和假设之间的总体推断关系,使用一个组合层来合成增强的局部推断信息。

开源地址:

Sequential Attention-based Network for Noetic End-to-End Response Selection

在今年的国际顶级语音会议ICASSP 2019上,陈谦再度大放异彩:基于ESIM的研究在公开的标准数据集Ubuntu(英文)和E-commerce(中文)上均取得了最高的成绩。

在序列推断模型中,继续使用BiLSTM序列来合成局部推断信息,然后将结果向量转化为池化的固定长度向量,并将其提供给最终的分类器来确定总体推断关系。

DSTC 7冠军论文:

https://arxiv.org/abs/1609.06038